A crise de confiança enfrentada pela BBC em 9–10 de novembro de 2025 expôs um vetor crítico de risco corporativo: quando modelos de IA — em especial LLM (Large Language Model) e RAG (Retrieval-Augmented Generation) — se ancoram em ecossistemas informativos sob questionamento, o viés latente pode transbordar para decisões executivas. O episódio combinou três elementos que importam para o board: um fato reputacional de alto impacto público; alegações sobre edição enganosa de conteúdo em um documentário; e a materialização de consequências de governança, incluindo renúncias de liderança e ameaça de litígio relevante. Não se trata de ideologia; trata-se de governança de dados, resiliência decisória e accountability.

No pano de fundo, pesquisas indicam que a composição de preferências políticas em redações no Reino Unido e no Brasil é majoritariamente inclinada à esquerda, elemento que não invalida o jornalismo, mas sinaliza a necessidade de contrapesos metodológicos quando esses conteúdos irrigam pipelines de IA corporativa. Em paralelo, levantamentos recentes da EY mostram perdas agregadas de aproximadamente US$ 4,4 bilhões relacionadas a riscos de IA — entre eles saídas enviesadas, falhas de compliance e impactos sobre sustentabilidade. Isso delimita o problema como risco operacional e financeiro, não como disputa cultural.

O caso BBC: fatos relevantes para governança

Linha do tempo sintética, com pontos materiais ao board:

- Disparo do evento. Em outubro de 2024, um episódio do programa Panorama abordou Donald Trump. Em novembro de 2025, veio a público um memorando interno — atribuído a Michael Prescott, ex-assessor do comitê de diretrizes editoriais — apontando que a edição do discurso de 6 de janeiro de 2021 teria agrupado trechos de forma a sugerir incitação, omitindo a passagem “peacefully and patriotically”, o que acendeu acusações de edição enganosa. A BBC é reportada como preparando pedido de desculpas pelo recorte adotado no episódio.

- Consequências de liderança e jurídicas. Em 9 de novembro de 2025, o diretor-geral Tim Davie e a CEO de BBC News, Deborah Turness, apresentaram renúncia em meio às críticas de parcialidade. Em paralelo, foi ventilada uma ameaça de ação judicial da ordem de US$ 1 bilhão por parte de Donald Trump, ampliando a materialidade do risco.

- Observações de governança. A discussão pública passou a incluir cobertura da BBC Arabic e critérios de curadoria de convidados, com alegações de vieses e de seleção problemática de fontes, o que reforça a lição central para empresas: provenance (rastro de origem) e curadoria importam tanto quanto a acurácia do modelo.

Premissas de prudência para comunicação executiva:

- Parte das alegações permanece em apuração e é disputada por diferentes atores.

- A lição corporativa não exige juízo político: exige controles de fonte, validação cruzada e transparência de edição quando conteúdos jornalísticos alimentam funções críticas de RAG (Retrieval-Augmented Generation).

Como o viés informacional entra em LLM e RAG

O viés pode infiltrar-se por três vias técnicas principais:

- Dados de treinamento. LLM (Large Language Model) herdam distribuições estatísticas das fontes; se o corpus tem assimetria temática/política, a superfície de decisão do modelo tende a refletir esse desequilíbrio. Estudos comparativos recentes mostram que preferências políticas podem ser medidas e até realinhadas por fine-tuning direcionado, confirmando que o viés não é inexorável, mas é mensurável.

- Recuperação de contexto. RAG (Retrieval-Augmented Generation) injeta documentos “atuais” nas respostas do LLM. Quando a recuperação privilegia fontes com framing enviesado, a saída pode piorar — inclusive ficando menos segura — e suscetível a ataques de envenenamento (data poisoning) que amplificam vieses. Pesquisas recentes e análises setoriais em finanças já alertam para essa contradição.

- Interação humano-modelo. Trabalhos na ACL (Association for Computational Linguistics) indicam que vieses “cognitivos” emergem em decisões assistidas por modelos e que exposições a modelos com inclinação política podem influenciar opiniões e escolhas dos usuários, o que eleva o padrão de diligência requerido em processos críticos.

O contexto informacional: dados demográficos de redações

- Reino Unido: 77% dos jornalistas se identificaram com a esquerda em 2023, segundo o Reuters Institute.

- Brasil: 80,7% dos jornalistas se identificaram com campos à esquerda (esquerda, centro-esquerda, extrema-esquerda) no Perfil do Jornalista Brasileiro 2021 (UFSC).

Esses números não qualificam a qualidade do jornalismo; indicam, isso sim, que decisões corporativas baseadas em conteúdo público precisam de contrapesos metodológicos para mitigar vieses sistêmicos.

Materialidade financeira e legal

- Perdas financeiras. A EY reporta perdas agregadas de ~US$ 4,4 bilhões entre grandes empresas associadas a riscos de IA, incluindo viés e saídas defeituosas. É um indicador de que a exposição já é orçamentariamente relevante.

- Multas regulatórias.

A moldura da GDPR (General Data Protection Regulation) prevê multas de até €20 milhões ou 4% do faturamento global, o que torna incidentes envolvendo dados pessoais — inclusive aqueles gerados por pipelines de IA — potencialmente catastróficos. No Brasil, a LGPD (Lei Geral de Proteção de Dados) autoriza a ANPD (Autoridade Nacional de Proteção de Dados) a aplicar sanções como advertência, multa simples de até 2% do faturamento da pessoa jurídica no Brasil (excluídos tributos), limitada a R$ 50.000.000,00 por infração, multa diária observando o mesmo teto, publicização da infração, bloqueio e eliminação de dados pessoais — reforçando a materialidade financeira e reputacional desses incidentes. - Efeito reputacional. Incidentes de conteúdo enganoso ou enviesado associados à marca podem produzir erosão de confiança entre stakeholders, aumentar custo de capital e desencadear reações regulatórias e judiciais regionais.

Riscos específicos para conselhos e diretorias

- Estratégia e alocação de capital. Modelos enviesados em geopolítica, energia ou ESG (Environmental, Social and Governance) podem inflar ou deflacionar percepções de risco e retorno, induzindo sobrealocações ou desinvestimentos prematuros.

- Mercado e comunicação. RAG sem controle pode priorizar fontes que alimentem narrativas em detrimento de dados primários, afetando guidance, notas a investidores e relações governamentais.

- Pessoas e compliance. Ferramentas de triagem e avaliação podem reproduzir vieses demográficos/ideológicos, gerando passivos trabalhistas e exposição antidiscriminação.

- Jurídico-regulatório. Sem governança robusta, incidentes de dados e decisões automatizadas opacas elevam o risco sob GDPR, LGPD (Lei Geral de Proteção de Dados), entre outras.

Framework de mitigação: controles de primeira linha

Arquitetura de fontes e proveniência de dados

- Estabelecer allowlists e denylists por domínio temático sensível.

- Implementar quotas de pluralidade editorial em coleções de RAG, com metas explícitas por espectro de opinião e região.

- Registrar provenance completo: URL, data/hora, versão, autorias e verificações.

- Rodar scans periódicos de segurança e qualidade em índices de busca interna para detectar envenenamento e conteúdo manipulado.

Validação e mensuração

- Definir KPI (Key Performance Indicator) de fairness por domínio: diferença máxima aceitável de tratamento entre grupos ou posições (<5% como linha-guia interna).

- Introduzir testes A/B com prompts balanceados e comitês “adversários” internos para desafios de framing.

- Incluir camadas de revisão humana em decisões materiais; instituir trilhas de auditoria legíveis para o conselho.

- Adotar benchmarks de viés reconhecidos (por exemplo, Parity Benchmark) e painéis internos para deriva (model drift) e estabilidade.

Segurança de RAG

- Mitigar amplificação de viés por re-rankers calibrados, expansão de consulta supervisionada e restrição de domínios em tópicos sensíveis.

- Aplicar defesas anti-poisoning e monitores de anomalia de conteúdo.

- Revisar o mito de “RAG sempre melhora a precisão”: resultados mostram que, sem curadoria, RAG pode degradar segurança e confiabilidade.

Governança e accountability

- Comitê de Ética em IA no nível do conselho, com mandato formal para pausar modelos em áreas sensíveis.

- DPO (Data Protection Officer) e Jurídico integrados desde o desenho do caso de uso, não apenas na homologação.

- Política de comunicação executiva que privilegie linguagem de risco, não rótulos políticos; planos de resposta a incidentes com prazos, responsáveis e mensagem-guia.

- Due diligence contínua de fornecedores de conteúdo e de modelos, com cláusulas contratuais de E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) para curadoria e explicabilidade.

Indicadores e métricas recomendadas

- Fairness Score por domínio: variação máxima entre grupos/posições (<5%).

- Taxa de discordância humana versus modelo em decisões materiais (<10% após tuning).

- Tempo de detecção e correção de conteúdo problemático em RAG (SLA – Service Level Agreement) por criticidade.

- Porcentual de respostas com provenance completo e verificável (meta >95% em relatórios de risco).

- Índice de estabilidade semântica: variação de resposta frente a fontes contrabalançadas num painel de teste.

- Taxa de incidentes regulatórios e tempo de resposta com comunicação pública padronizada (inclui obrigação de reporte quando aplicável à GDPR/LGPD).

Aplicando as lições do caso BBC sem politizar

O valor do caso BBC para conselhos está em cinco lições táticas, independentes de preferência política:

- Tratem conteúdo de mídia como dado volátil. A curadoria editorial segue incentivos e contextos próprios; o uso corporativo exige filtros adicionais e validação cruzada.

- Evitem dependência de fonte única para temas sensíveis. Use pluralidade sistemática e metas explícitas de diversidade de fontes.

- Diferenciem erro editorial de má-fé. A resposta de governança não parte de julgamentos ideológicos, mas de materialidade, correção e prevenção.

- Instituam guard-rails antes do incidente. Red-teaming periódico reduz o espaço de surpresa.

- Protejam a organização contra externalidades jurídicas. Ameaças de litígio e escrutínio público podem se estender a quem republica ou opera sobre conteúdos potencialmente enganosos.

Roadmap 30–60–90 para o board

30 dias — diagnóstico e contenção

- Inventário completo de fontes em RAG e datasets de treinamento de LLM.

- Varredura de viés e sensibilidade por domínio (geopolítica, energia, saúde, hiring).

- Quarentena de coleções com baixa rastreabilidade; ativação de monitores de anomalia.

- Política provisória de comunicação executiva: linguagem de risco, sem adjetivação política.

60 dias — hardening e mensuração

- Implementação de allowlists/denylists e quotas de pluralidade editorial.

- Benchmarks de viés e fairness; painéis de drift e estabilidade semântica.

- Re-rankers e reescore de recuperação com avaliação humana cega.

- Contratos com fornecedores de conteúdo e modelos com cláusulas de provenance, E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) e auditoria.

90 dias — governança contínua

- Comitê de Ética em IA reportando ao conselho com agenda trimestral.

- Rotina de relatórios executivos com KPI de fairness, estabilidade e incidentes.

- Programa de red-teaming e exercícios de crise (tabletop) semestrais.

- Integração com compliance regulatório, incluindo GDPR e LGPD, com avaliação de risco de multa.

Perguntas que o conselho deve fazer imediatamente

- Quais decisões materiais hoje dependem de RAG/LLM e quais são as fontes subjacentes?

- Qual é a porcentagem de respostas de risco com provenance completo e auditável?

- Que testes de viés e estabilidade executamos nos últimos 90 dias, com que resultados?

- Qual é o apetite ao risco do conselho para vieses residuais em domínios sensíveis?

- Em caso de incidente, qual é o tempo alvo para correção e retratação pública?

- Há cláusulas contratuais que nos protejam de passivos de terceiros originados por conteúdo de mídia manipulado?

Indicadores-chave para contextualização neutra

- 77% dos jornalistas no Reino Unido se identificam com a esquerda em 2023.

- 80,7% dos jornalistas no Brasil se identificam com campos à esquerda.

- ~US$ 4,4 bilhões em perdas ligadas a riscos de IA reportadas por grandes empresas, segundo pesquisa EY de 2025.

- GDPR (General Data Protection Regulation), UE: multas de até € 20 milhões ou 4% do faturamento global, o que for maior.

- LGPD (Lei Geral de Proteção de Dados), Brasil: sanções da ANPD (Autoridade Nacional de Proteção de Dados) incluem advertência; multa simples de até 2% do faturamento no Brasil (excluídos tributos), limitada a R$ 50 milhões por infração; multa diária (respeitado o mesmo teto); publicização da infração; bloqueio e eliminação de dados; e, nos casos graves, suspensão de funcionamento de banco de dados/atividade de tratamento.

- Mídia dos EUA — análise de linguagem: estudo do The Economist (dez/2023), ao comparar vocabulário associado a democratas vs. republicanos, encontrou que, entre os 20 sites de notícias mais lidos, 17 usaram mais expressões ligadas a democratas. Metodologia: dicionário de 428 frases aplicado a 242 mil artigos e 397 mil transcrições de TV.

- Evidências acadêmicas recentes de que RAG pode amplificar viés e, sem curadoria, degradar segurança; e de que vieses em modelos podem influenciar decisões de usuários.

Mensagem-guia para blindagem reputacional

A organização adota uma posição de neutralidade institucional: não endossa teses políticas; adota métricas, controles e transparência de fontes. Em comunicações públicas, privilegia-se a linguagem de risco e governança. O caso BBC é tratado como estudo de governança de dados e decisões, não como instrumento de disputa cultural.

Como podemos ajudar?

Diagnostic Express de IA

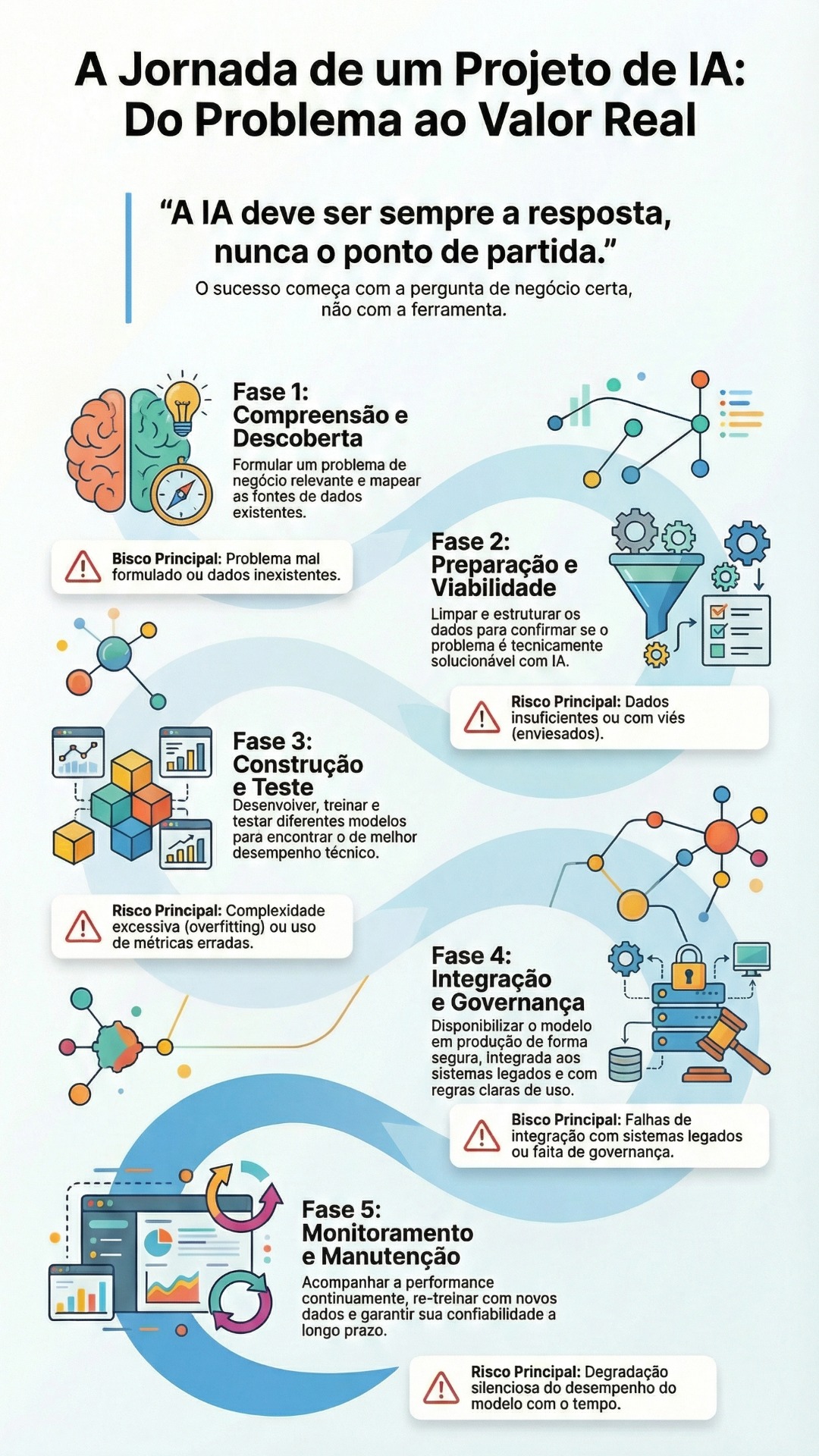

Sessão de 2 horas com líderes de Risco, Dados, Jurídico e Comunicação para mapear fontes críticas e decisões suportadas por RAG (Retrieval-Augmented Generation) e LLM (Large Language Model), avaliar vieses, priorizar controles e pactuar um plano 30–60–90;

Método baseado em checklist proprietário, scoring de materialidade, matrizes de risco e princípios de proveniência/rastreabilidade;

Entregáveis em até 48 horas úteis incluem checklist com 10–15 controles prioritários, matriz de materialidade, template de política de proveniência de dados, mini-backlog do plano com owners, marcos e KPIs (Key Performance Indicators) e sumário de decisões materiais impactadas;

Fora do escopo estão alterações em produção e coleta de dados pessoais; sucesso medido por top 5 riscos definidos, plano e métricas acordados;

Opcionais sob demanda: quick scan técnico de RAG e simulação de incidente com playbook de resposta.

Observações finais

- Evitar números controvertidos ou não replicáveis em documento público. Trabalhar com métricas auditáveis, estudos reconhecidos e dados de reguladores.

- Manter distanciamento de rótulos partidários; ancorar as recomendações em práticas de compliance e gestão de risco.

- Em temas altamente sensíveis, revisar conteúdos com dupla checagem jurídica e de dados antes de alimentar RAG.